¿Una supervisión artificial? el uso de la IA en la supervisión financiera

Análisis OFT – 13 / 2026

Fecha: 31 marzo 2026

| LAS CLAVES La inteligencia artificial mejora la supervisión bancaria y financiera mediante el procesamiento masivo de datos, facilitando la detección temprana de riesgos y la automatización de tareas rutinarias, aumentando la eficiencia y capacidad analítica. Su adopción crece a nivel global, especialmente en funciones operativas como análisis de datos o redacción, aunque todavía existe un amplio potencial para aplicaciones estratégicas más avanzadas. La implementación de IA plantea retos relevantes, incluyendo la necesidad de capacidades técnicas especializadas, marcos de gobernanza sólidos, alta calidad de datos y adaptación de la regulación existente. Los principales riesgos incluyen privacidad, ciberseguridad, falta de transparencia, dependencia de proveedores externos y errores en modelos, lo que exige reforzar la cooperación entre autoridades nacionales e internacionales. |

La inteligencia artificial en la supervisión bancaria y financiera

La inteligencia artificial (IA) no solo está transformando la operativa de las entidades financieras, sino que también ofrece un potencial significativo para mejorar la eficacia y eficiencia de los supervisores bancarios. Las autoridades pueden aprovechar la IA para procesar grandes volúmenes de información de forma automatizada, lo que permite un análisis más profundo y continuo de los riesgos del sistema financiero. Por ejemplo, el uso de técnicas de machine learning facilita la detección temprana de anomalías en los datos regulatorios reportados por las entidades, ayudando a identificar posibles problemas de solvencia o liquidez antes de que se materialicen. Asimismo, la IA puede aplicarse en el análisis de riesgos conductuales, mediante el procesamiento de comunicaciones internas o reclamaciones de clientes, con el fin de detectar prácticas inadecuadas o posibles incumplimientos normativos. Otro ámbito clave es la supervisión del riesgo sistémico, donde los modelos avanzados permiten simular escenarios complejos y analizar interconexiones entre entidades. Además, la automatización de tareas rutinarias, como la revisión de reportes regulatorios, libera recursos que pueden destinarse a análisis más estratégicos. Finalmente, la IA también puede mejorar la priorización supervisora, ayudando a focalizar la atención en aquellas entidades o áreas con mayor perfil de riesgo.

Adopción y casos de uso de la inteligencia artificial por parte de las autoridades supervisoras

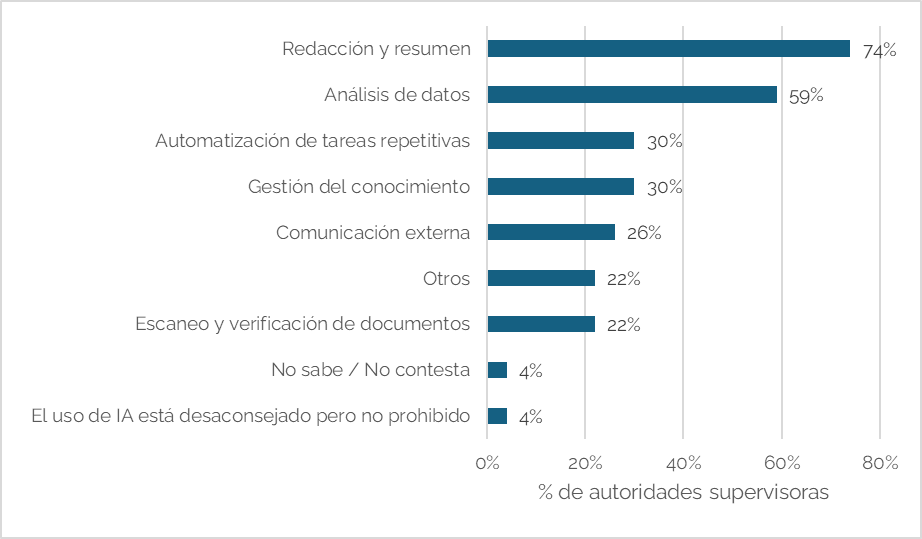

Las autoridades supervisoras empiezan a hacer un uso cada vez más intenso de la IA. En el caso europeo, el Banco Central Europeo (BCE) utiliza ampliamente la IA para mejorar la previsión económica, aumentar la eficiencia de la supervisión y automatizar el análisis de datos[1]. Por su parte, la Reserva Federal también utiliza la IA para aplicaciones en el análisis de datos, el procesamiento del lenguaje natural para pronósticos económicos y tareas administrativas. Pero el uso de esta tecnología no solo se concentra en las economías avanzadas, según los datos más recientes de la World Bank Survey on AI in Supervision (2025), también las autoridades de economías emergentes y en desarrollo han comenzado recientemente a adoptar políticas y estrategias formales en relación con el uso interno de la IA. En concreto, el 26% de las autoridades supervisoras de estas economías ya dispone de una política formal que regula el uso interno de la IA. En cuanto a los casos de uso, el Gráfico 1 refleja un uso bastante amplio. El gráfico muestra que los supervisores utilizan principalmente la IA para tareas operativas como redacción, resumen y análisis de datos, reflejando un enfoque inicial en eficiencia. Sin embargo, usos más avanzados, como verificación documental o comunicación, tienen menor adopción, lo que sugiere un margen significativo para ampliar su aplicación estratégica en supervisión. En cualquier caso, algunas autoridades restringen el uso de la IA a casos de uso específicos y mantienen una estricta supervisión humana.

Gráfico 1. Casos de uso de la IA entre los supervisores bancarios

Fuente: World Bank Survey on AI in Supervision y elaboración propia.

Riesgos en el uso de la inteligencia artificial con un fin supervisor

El uso de la IA por parte de los supervisores también plantea importantes retos. No es un proceso sencillo, ya que requiere capacidades técnicas, gobernanza adecuada y calidad de los datos. Además, surgen riesgos relacionados con la interpretabilidad de los modelos, la dependencia tecnológica y la necesidad de adaptar los marcos regulatorios existentes. En este contexto, y tal y como se muestra en la Tabla 1, los supervisores identifican como principales preocupaciones la seguridad de los datos y la privacidad, seguidas de los riesgos de ciberseguridad. Asimismo, destacan la falta de transparencia en los sistemas de IA —especialmente por su carácter de “caja negra”— y los riesgos operativos derivados de una excesiva dependencia o posibles fallos en estos sistemas. A ello se suma la creciente dependencia de proveedores externos, que puede generar riesgos de concentración, así como la posibilidad de obtener resultados inexactos o sesgados (por ejemplo, alucinaciones), lo que puede comprometer la calidad del análisis supervisor. En cualquier caso, parece ser crucial la colaboración. Casi todas las autoridades financieras indican la necesidad de colaborar con otros reguladores nacionales —como los que supervisan la protección de datos y la ciberseguridad— para compartir información, abordar posibles lagunas y solapamientos regulatorios, y garantizar una comprensión coherente de las expectativas relacionadas con la IA. El intercambio transfronterizo de información y mejores prácticas también se considera ampliamente esencial, en particular para las autoridades que supervisan instituciones con operaciones internacionales.

Tabla 1. Riesgos percibidos por las autoridades supervisoras al usar la IA

| Importancia / Ranking | Riesgo |

| 1 | Seguridad de los datos y privacidad |

| 2 | Riesgos de ciberseguridad |

| 3 | Falta de transparencia en los sistemas de IA (explicabilidad o “caja negra”) |

| 4 | Riesgos operativos por excesiva dependencia de la IA o fallos en sistemas basados en IA |

| 5 | Dependencia excesiva de proveedores externos de IA y riesgos de concentración |

| 6 | Resultados inexactos de los modelos |

Fuente: World Bank Survey on AI in Supervision y elaboración propia.

[1] Benefits from advanced technology infrastructure in supervision. BCE. 14 Mayo 2025. https://www.bankingsupervision.europa.eu/press/supervisory-newsletters/newsletter/2025/html/ssm.nl250514.en.html